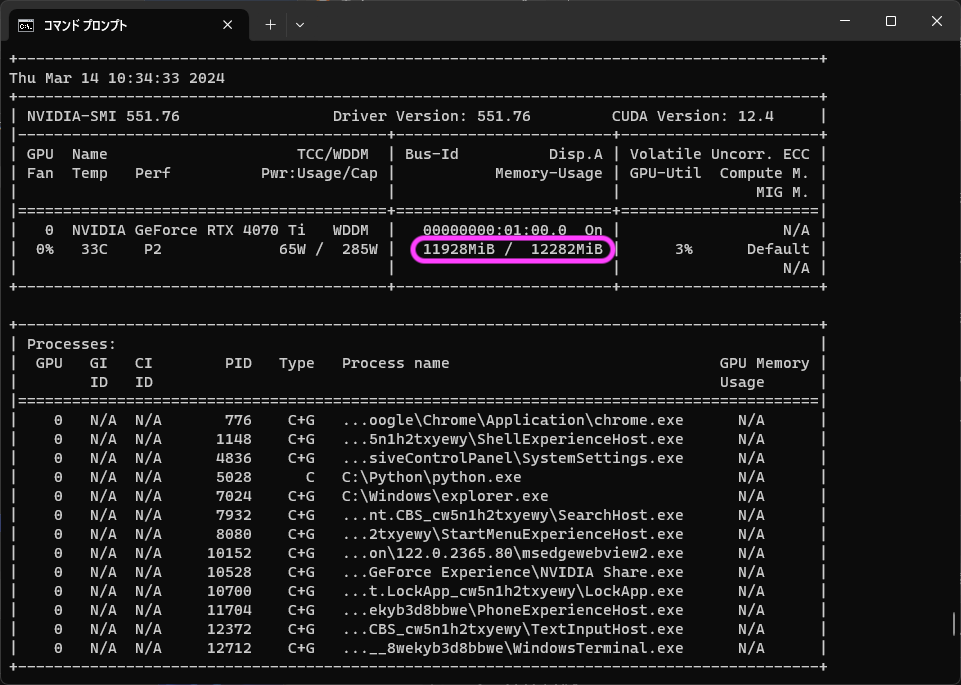

Windows11PCでの推論実行時のVRAM消費量と消費電力を調べました。

GPU:GeForce RTX 4070Ti 12GB

LLM : ELYZA-japanese-CodeLlama-7b

プロンプト:Swiftコードに関する簡単な補足依頼。回答まで1分10秒程度。

VRAM消費量測定:nvidia-smiコマンド

消費電力測定:SwitchBotミニプラグのアプリ画面から読み取り

VRAM消費量はほぼ12GBでフル使用でした。消費電力は最大168Wで電源ユニット750Wに対してかなり余裕がありました。

# 1秒おきにGPU使用状況を表示

nvidia-smi -l 1